点击右上角![]() 微信好友

微信好友

朋友圈

朋友圈

请使用浏览器分享功能进行分享

【经济界面】

光明日报记者 刘坤 光明日报通讯员 柳素雯

夜深人静时,有人找它线上聊天、获取慰藉;视频带货时,有人用它快速生成营销文案;同学聚会时,有人用它现场作诗助兴……它,就是很多人眼中的“生活好帮手”“工作好搭子”——人工智能(AI)大模型。

近期,多款大模型产品横空出世、风靡全球,再次掀起人工智能热潮。但与此同时,也有一些人利用人工智能生成合成虚假内容,或为吸引眼球、赚取流量,或试图以假乱真、造谣诈骗等,带来一定风险和隐患,引发社会关注。

近日,国家互联网信息办公室、工业和信息化部、公安部、国家广播电视总局联合发布《人工智能生成合成内容标识办法》(以下简称《办法》)。《办法》聚焦人工智能“生成合成内容标识”关键点,通过标识提醒用户辨别虚假信息,明确相关服务主体的标识责任义务,规范内容制作、传播各环节标识行为,将于2025年9月1日起施行。

如何让人工智能生成合成内容“亮明身份”,不再“真假难辨”?如何破解人工智能安全治理难题?记者就此进行了采访。

江苏省苏州市“人工智能+”创新发展推进大会上展示的人形机器人。新华社发

人工智能合成让人真假难辨

小猫小狗随着音乐跳起舞蹈,家中“萌娃”大战公鸡……在短视频平台上,人们不时会刷到类似视频。其实,一些传播量、点赞量都很大的“神奇视频”并非是真实的,而是由人工智能生成合成的。

所谓人工智能生成合成内容,是指利用人工智能技术生成、合成的文本、图片、音频、视频、虚拟场景等信息。

近年来,人工智能技术快速发展,为生成合成文字、图片、音频、视频等信息提供了便利工具,海量信息得以快速生成合成并在网络平台传播,在促进经济发展、丰富网上内容、便利公众生活的同时,也带来生成合成技术滥用、破坏网络生态等问题,引发社会各界的关注。

“一些喜欢我参演的影视剧的观众,被AI换脸视频骗得很惨,这个性质非常恶劣。”一位演员说,希望能建立更好的规范。实际上,不少公众人物都遭遇过类似问题。

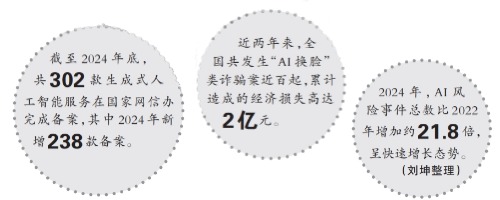

公安部数据显示,近两年来,全国共发生“AI换脸”类诈骗案近百起,累计造成的经济损失高达2亿元。

“人工智能生成合成内容日益逼真,也催生虚假消息传播、身份信息冒充、恶意内容生成等新型安全风险,并削弱着公众对网络传播内容的信任根基。”中国工程院院士、浙江大学教授陈纯说。

中国电子信息产业发展研究院副总工程师刘权认为,人工智能大模型本身存在不可解释性问题。大模型运作机制不透明,产生的“黑箱”属性导致不可解释性。这种不可解释性降低了可信度,使得输出的内容可能存在事实性错误和偏差,特别是在医疗、金融等领域,难以满足严苛的可信要求。

中国社会科学院大学互联网法治研究中心主任刘晓春表示,通过人工智能生成合成技术降低了内容“伪造”“造假”等的时间成本,尤其在图片、音频、视频等领域,从早期引起广泛关注的“换脸”工具,到伪造人声、通话视频的诈骗活动,再到“被压在废墟下的小男孩”等热点事件,人工智能技术带来的深度伪造、虚假信息、不良信息、抄袭侵权等问题,对包括内容治理在内的网络空间秩序构成挑战,对治理工具、方式和手段也提出了更新更高的要求。

数据显示,截至2024年底,共302款生成式人工智能服务在国家网信办完成备案,其中当年新增238款备案。

“当前,大模型能够生成高真实感的文本、人像、场景、音频,普通民众不借助检测工具往往很难辨别内容真伪。”中国科学院计算技术研究所数字内容合成与伪造检测实验室主任、研究员曹娟认为,随着生成式人工智能技术在各个行业落地应用,生成合成内容的数据规模快速增长,对生成内容进行全面检测成本太高。生成合成内容适用场景大幅扩展,助长了欺骗场景多样化。

在山东青岛某中学举行的科技节活动中,学生们观看机器狗表演。 光明图片 张鹰摄

打造可信赖的AI技术

《办法》的推出是我国推进人工智能领域安全治理、促进产业规范健康发展、引导技术向善的重要举措,标志着我国在生成式人工智能领域迈出了构建安全可信生态的关键一步。

国家互联网信息办公室有关负责人介绍,《办法》重点解决“哪些是生成的”“谁生成的”“从哪里生成的”等问题,推动由生成到传播各环节的全流程安全管理,力争打造可信赖的人工智能技术。

针对服务提供者,《办法》明确,应当对文本、音频、图片、视频、虚拟场景等生成合成内容添加显式标识,在提供生成合成内容下载、复制、导出等功能时,应当确保文件中含有满足要求的显式标识;应当在生成合成内容的文件元数据中添加隐式标识。

针对互联网应用程序分发平台,《办法》提出在应用程序上架或者上线审核时,应当要求互联网应用程序服务提供者说明是否提供人工智能生成合成服务,并核验其生成合成内容标识相关材料。

针对用户,《办法》提出,用户使用网络信息内容传播服务发布生成合成内容的,应当主动声明并使用服务提供者提供的标识功能进行标识。

此外,任何组织和个人不得恶意删除、篡改、伪造、隐匿本办法规定的生成合成内容标识,不得为他人实施上述恶意行为提供工具或者服务,不得通过不正当标识手段损害他人合法权益。

“《办法》以合理成本提高安全性,促进人工智能在文本对话、内容制作、辅助设计等各应用场景加快落地,同时减轻人工智能生成合成技术滥用危害,防范利用人工智能技术制作传播虚假信息等风险行为,推动人工智能健康有序发展。”该负责人说。

中国政法大学数据法治研究院教授张凌寒认为,人工智能生成内容标识制度具备独特制度价值。标识能够有效区分出人工智能生成合成的信息,防范虚假信息的传播利用;标识能够帮助用户快速了解生成式人工智能产品和服务的相关属性或参数信息;标识能够协助监管部门对生成式人工智能产品或服务实施评估、追溯等监管,推进人工智能生成合成内容合法合规发展。

张凌寒表示,目前,人工智能生成合成内容标识制度主要关注“是否机器生成”的形式判断。随着标识技术的进步与发展,未来标识制度能够发挥更为丰富的功能,从形式判断逐渐转向“是否足够可靠”的质量判断,进一步促进行业健康发展。

安全治理进入“深水区”

良法善治,重在实施。

为推动《办法》落地实施,强制性国家标准《网络安全技术 人工智能生成合成内容标识方法》同步发布,更好地指导相关主体规范开展标识活动。

“当前,人工智能安全治理已从危害探讨进入实际执法的深水区。”曹娟说,大模型生成技术迭代更新很快,平均两个月就会出现新的里程碑模型,提升针对新生伪造方法的泛化能力至关重要,需要摒弃“来一个打一枪”的事后思维,构建AI鉴伪底座模型,提高鉴伪模型的泛化适用性能。

曹娟表示,要研究精准化对抗鉴伪技术,防范恶意逃避风险。同时,降低对无害生成内容传播的影响,兼顾生成内容应用的发展与治理,打造全民化伪造检测工具,推动人人可用鉴伪。

“可以预见,我国人工智能安全执法将延续重点事项监管、促进产业有序发展的方向。”公安部第三研究所副所长金波说,伴随标识管理与算法备案、安全评估等机制逐步实现有机衔接,生成合成内容标识合规或将成为相关部门开展人工智能监督检查、专项行动的重点关注领域。在此进程中,如何平衡好发展与安全、创新与责任,提升执法的专业化、精细化、智慧化水平,从而培育出安全、开放、公平的人工智能产业生态环境,还需要深入探究。

“此外,‘人的因素’应融入人工智能标识管理的全过程。”金波表示,要着重提升公众对信息内容真实性、来源可追溯性的评估能力,积极培育公众的人工智能素养,确保人工智能技术成果普惠共享。

在陈纯看来,《办法》的落地离不开全社会凝心聚力和协同配合。地方主管部门、高校、科研机构、企业可共同参与,形成标识工作先行的多点协同内容治理网络,推动标识工作行稳致远。此外,有必要建立全国性的内容标识公共服务平台,以可视可交互的实际操练形式,促进公众和产业深入理解标识工作。

“生成式人工智能促使信息技术从普通工具属性向‘思维伙伴’型高智能化工具属性进化,带来颠覆性发展机遇,未来势必成为我们的必备技能,这要求我们在使用时切实正确理解并管理人工智能。”陈纯说。

《光明日报》(2025年03月27日 15版)